La Unión Europea acuerda la primera Ley de Inteligencia Artificial del mundo

La Unión Europea ha llegado a un acuerdo para crear la primera Ley de Inteligencia Artificial del mundo.

El objetivo principal que persigue esta ley es que los sistemas IA sean seguros y respeten los valores y derechos fundamentales de la UE.

Una ley que busca legislar sobre un terreno casi desconocido y que se mueve entre el temor de perder competitividad de las empresas europeas ante países sin regulación como China y EEUU y la necesidad de proteger la seguridad y la privacidad de los usuarios.

Noticia sobre el acuerdo de la Ley de Inteligencia Artificial de la Unión Europea en RTVE

El acuerdo se ha producido tras largas horas de negociaciones y es el primer paso para crear las primeras normas legales sobre IA en el mundo.

Puntos destacados de la Ley IA de la UE

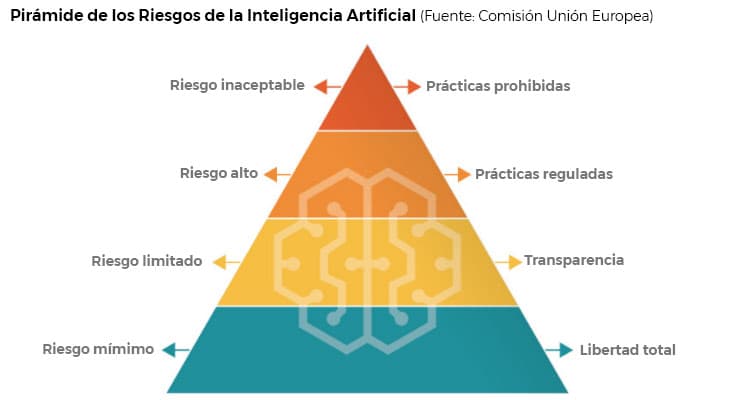

La Ley Europea de Inteligencia Artificial clasifica tres niveles de riesgo en función de cómo afecta la IA a los derechos fundamentales de las personas. Dichos niveles implicarán una mayor o menor regulación. Te los detallamos más adelante.

El incumplimiento de las normas supondrá multas del 7% de la facturación.

No se podrán reconocer las emociones en empresas o colegios, pero sí se podrá usar vigilancia biométrica.

¿A quién aplicará este reglamento?

- Proveedores que pongan en servicio IA en la Unión Europea

- Usuarios de IA que estén en la Unión Europea

- Proveedores y usuarios de IA que estén en un país fuera de la Unión Europea cuando su información generada se use en la UE

Muchas pymes seremos usuarias de Inteligencia Artificial, por lo que debemos identificar cómo y dónde utilizamos la IA para poder planificar procesos que se ajusten a la nueva normativa antes de que entre en vigor. Debemos estar preparados en este nuevo escenario legislativo.

Niveles de riesgos establecidos en la Ley de Inteligencia Artificial Europea

La nueva normativa establece obligaciones para proveedores y usuarios en función del nivel de riesgo de la IA. Aunque muchos sistemas de IA plantean un riesgo mínimo, es necesario evaluarlos todos.

Nivel de riesgo inaceptable

Los sistemas de IA mas críticos se consideran una amenaza para las personas y serán prohibidos. Estos incluyen:

- Manipulación del comportamiento de personas o grupos vulnerables específicos.

- Clasificación social de personas en función de su comportamiento, estatus socioeconómico o características personales

- Identificación biométrica en tiempo real y a distancia, como el reconocimiento facial.

Esta clasificación cuenta con excepciones, por ejemplo, los sistemas de identificación biométrica a distancia podrán usarse para para perseguir delitos graves previa aprobación judicial.

Nivel de riesgo alto

Son sistemas de IA que afectan negativamente a la seguridad o a los derechos fundamentales:

- IA utilizada en productos sujetos a la legislación de la UE sobre seguridad de los productos (juguetes, aviación, automóviles, dispositivos médicos y ascensores).

- Los sistemas de IA pertenecientes a ocho ámbitos específicos que deberán registrarse en una base de datos de la UE:

- Identificación biométrica y categorización de personas físicas

- Gestión y explotación de infraestructuras críticas

- Educación y formación profesional

- Empleo, gestión de trabajadores y acceso al autoempleo

- Acceso y disfrute de servicios privados esenciales y servicios y prestaciones públicas

- Aplicación de la ley

- Gestión de la migración, el asilo y el control de fronteras

- Asistencia en la interpretación jurídica y aplicación de la ley.

Todos los sistemas de IA de alto riesgo serán evaluados antes de su comercialización y a lo largo de su ciclo de vida.

Nivel de riesgo limitado

Estos sistemas de IA deben cumplir unos requisitos mínimos de transparencia que permitan a los usuarios tomar decisiones con conocimiento de causa. TES decir, los usuarios deben ser conscientes de cuándo están interactuando con la Inteligencia Artificial para decidir si desea seguir utilizándolas. Esto incluye los sistemas de Inteligencia Artificial Generativa que generan o manipulan contenidos de imagen, audio o vídeo (por ejemplo, deepfakes).

Nivel de reisgo mínimo

Este nivel no contempla ninguna obligación, así que en este punto existe total libertad.

Regulación de la Inteligencia Artificial generativa

La IA generativa, como ChatGPT, Bing, Dall-E o Stumble diffusion, deberá cumplir estos requisitos de transparencia:

- Revelar que el contenido ha sido generado por IA

- Evitar la generación de contenidos ilegales

- Publicar resúmenes de los datos protegidos por derechos de autor que hayan sido utilizados para el entrenamiento de la IA

¿Cuándo entra en vigor la Ley de Inteligencia Artificial Europea?

Aunque no cabe duda de que se trata de un paso importantísimo en legislación sobre inteligencia artificial a nivel mundial, de momento no se trata de una ley, sino de un acuerdo. Dicho consenso deberá ser aprobado por el Parlamento Europeo antes de fin de este año y de las próximas ‘euroelecciones’. En cualquier caso, según los plazos de los trámites europarlamentarios, la regulación de la IA no podría aplicarse antes de 2026.

Cómo aplicar la IA en las empresas.

Si te interesa cómo aplicar la inteligencia Artificial en tu negocio, aquí te dejamos un interesante artículo que te ayudará.

Seguiremos atentos a los avances de la Ley de Inteligencia Artificial.

Archivado en: